Septiembre es uno de mis momentos favoritos del año. Además de porque empieza a desaparecer el asfixiante calor del verano, es el mes en el que suele presentarse el nuevo iPhone.

Hace años que abandoné casi completamente el uso de cámaras dedicadas y me centré en usar móviles para mis fotos y vídeos, excepto en contados casos de trabajo donde saco la Fuji). Así que me llena de emoción ver las mejoras y tecnologías que se incluyen con cada nuevo modelo.

Aunque el iPhone lleva 14 años con nosotros, considero que la tecnología de cámara del mundo móvil sigue estando un poco en pañales y quedan muchas capacidades por desarrollar.

Apple promete que la cámara del iPhone 13 Pro supone uno de los mayores saltos hacia delante en la historia del dispositivo; y aunque creo que lo han exagerado un poco, es cierto que la mejora desde el 12 Pro es bastante notable, pero no por razones obvias.

El problema con este salto es que se debe más a las “carencias” del sistema de cámara del 12 que a las mejoras del 13. Con esto no quiero decir que la cámara del iPhone 12 Pro sea mala, si no que no mejora sustancialmente a la del 11, sobre todo las lentes gran angular y telefoto. Incluso en el 12 Pro Max, que incluía sensor nuevo, las mejoras fueron sutiles. Diría que incluso decepcionantes para lo mucho que prometía.

Veamos por separado cada una de las cámaras que componen el sistema de cámara del iPhone 13 Pro y Pro Max. Recordad que este año ambas son iguales.

La cámara principal

La principal, la que la mayoría de usuarios usan para casi todas las fotos que hacen. El angular suele ser el sensor al que Apple presta más atención y este año se han lucido, al menos a nivel de hardware.

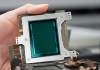

Se ha aumentado el tamaño del sensor hasta los 1/1.65”, comparado con 1/1.9” en el 12 Pro Max y 1/2.55” en el 12 Pro. Ya, yo tampoco consigo visualizar lo que significan estos números, pero creo que se entiende mejor si decimos que el sensor del 13 Pro tiene un área de 44 mm2, el 12 Pro Max de 35.2 mm2 y el 12 Pro 23.9 mm2.

Todo esto viene a significar que el 13 Pro puede capturar un 84% más de luz que el 12 Pro, gracias también a sus píxeles de 1.9 µm (1.4 µm en el 12 Pro).

Además se ha mejorado la apertura, que baja de f1.6 a f1.5. Sin ser un cambio brutal, todo ayuda. Esta cámara es la única con estabilización del sensor y no solo de la óptica.

Los resultados de estas mejoras son más evidentes en elementos como la profundidad de campo y la velocidad de disparo que en la calidad de las fotos en sí. Empiezo a creer que Apple plantea un baremo interno de calidad con sus algoritmos y utiliza las mejoras del sensor para optimizar todos los elementos que rodean a ese nivel de calidad base.

Me explico: no veo que las fotos hechas con el iPhone 13 Pro tengan mejor nivel de detalle en texturas que las hechas con un 12 Pro, lo que me lleva a pensar que no se ha retocado el algoritmo de procesado para obtener mas detalle, pese a que el nuevo sensor debería permitirlo.

Lo que sí veo son pequeñas mejoras en el balance de blancos, exposición de caras y color. En pruebas mas clínicas en muy baja luz es donde empiezo a ver al iPhone 13 Pro disparar en ISO 3000 mientras el 12 Pro Max se va hasta el ISO 5000, pero en condiciones de buena y media luz no parece haber casi diferencia en la calidad general de la foto.

Es como si Apple considerase que en buena luz ya habían alcanzado un nivel de calidad suficiente, así que no se han molestado en modificar el procesado para extraer todo el detalle posible, que si has disparado alguna vez en RAW sabes que está ahí.

La profundidad de campo y el bokeh que genera el nuevo combo sensor/lente es mucho más placentero en el 13 Pro. Hay veces que haces una foto a un objeto y parece que esté hecha con el modo retrato. Aquí sí que se nota la evolución.

Otro aspecto que mejora gracias al nuevo sensor es que el modo noche necesita menos tiempo para capturar, así que las posibilidades de que salga una foto mal se reducen. Aunque no lo he probado, sospecho que la astrofotografía ha mejorado muchísimo con el nuevo sensor.

La distancia mínima de enfoque de esta nueva cámara es pobre, como ya lo era en el 12 Pro Max, pero al menos ahora tenemos el modo macro para paliarlo. Más sobre esto en la sección del Gran Angular.

La cámara principal también es la única que lleva un sistema de eliminación de reflejos en la lente. Si, iOS 15 elimina automáticamente esos pequeños orbes verdes que salen en las fotos cuando una luz refleja sobre la lente (en iPhone 12 también!).

Eso si, solo funciona cuando el orbe no es muy grande y solo hay uno. No entiendo por qué Apple no cambia el tratamiento de las lentes de la cámara para que esto no ocurra, pero empieza a ser desesperante, sobre todo grabando video, donde es fácil ver un ejército de flares bailar en la imagen.

Gran angular y macro

La lente gran angular o ultrawide ha sido la más floja en los iPhone desde que apareció con el iPhone 11. Este año ha recibido una mejora brutal gracias a su nuevo diafragma f1.8 (F2.4 antes) y el añadido de autofocus, que lo convierte en una lente macro bastante decente.

Hay que ser claros: en media/baja luz el gran angular sigue siendo bastante pobre. Es mejor que antes, si, pero los bordes pierden nitidez fácilmente y casi te obliga a recortarlos para ver una foto decente cuando no hay mucha luz.

Dicho esto, el incremento de luminosidad lo hace más usable en situaciones donde antes no pensarías utilizarlo porque sabías que no ibas a poder distinguir nada en la foto. Junto con el modo noche es posible sacar fotos bastante espectaculares, pero hay que ser consciente de sus limitaciones.

Donde realmente esta cámara se luce es en el modo macro. Se podría decir que le da al iPhone una cámara extra; es así de útil. La distancia de enfoque de 2 centímetros es suficiente para hacer fotos de texturas y crear imágenes casi surrealistas.

Hay dos modos de usar el macro. Desde la cámara principal, al acercarte lo suficiente a un objeto se cambia automáticamente de lente y se hace un recorte del gran angular para evitar la distorsión. Esto es lo que usará la mayoría de la gente.

Este cambio automático de lente no se puede desactivar, pero Apple dice que añadirán la opción más adelante.

La otra opción es cambiar al gran angular y usarlo tal cual. La diferencia es que veremos la foto más “alejada”, mucho más distorsionada y con bordes menos nítidos, pero te da la flexibilidad de hacer el recorte después en la app que te apetezca, asumiendo que quieras recortar siquiera.

Al final, gracias a la nueva lente y al autofocus, el gran angular es probablemente la cámara que más ha mejorado a efectos prácticos, pese a que el sensor siga teniendo el mismo tamaño que el año pasado.

El teleobjetivo de 77 milímetros

He dicho muchas veces que el telefoto es mi modulo favorito del iPhone. Hasta ahora, el 2x, equivalente a unos 50 mm, me ofrecía un punto de vista más “cinematográfico”, me permitía aplastar ligeramente las distancias y encuadrar de forma más precisa y con menos distorsiones. Algo tiene que me encanta. En cámaras grandes también suelo usar más las focales entre 50 y 100 mm.

El año pasado el iPhone 12 Pro Max montaba un telefoto 2.5x que a priori parecía ser mejor. Sin embargo a lo largo de los meses he acabado haciendo menos fotos de las que hacía con el 2x, y es que ese 0.5x extra de alcance (de 50 mm a 65 mm aprox) no terminó de cuajar conmigo.

Cuando Apple anunció que el iPhone 13 Pro llevaría un telefoto 3x me asusté, pero ha terminado gustándome mucho más que el del año pasado. Sí, más alcance implica más dificultad a la hora de encuadrar objetos que no estén lejos, pero también me da un look incluso más cinematográfico, gracias al bokeh natural que aporta una focal más larga. Los retratos especialmente lucen increíbles sin necesidad de usar el modo retrato.

La parte mala es que el diafragma ha empeorado hasta los f2.8 (f2.2 en 12 Pro Max y f2.0 en 12 Pro) y dado que el sensor sigue teniendo el mismo tamaño (píxeles de 1.0 µm) el rendimiento en media luz es regulero y en baja luz, pobre.

Por otro lado, al menos ahora soporta modo noche, aunque si no hay luz suficiente seguirá utilizando un recorte del sensor principal en lugar de usar el tele. Es triste que a estas alturas se siga sin poder desactivar que el iPhone cambie de lente automáticamente en base a la luz disponible, teniendo que usar aplicaciones independientes o el modo retrato para forzarlo.

La nitidez de este nueva cámara es correcta porque al final estamos usando el mismo procesado que el resto de sensores. En mi opinión donde realmente se luce esta lente es disparando en RAW (no ProRAW) y es que se puede extraer mucho más detalle de este modo, aunque el sensor es bastante ruidoso.

Al final me quedo gratamente sorprendido por este 3x y lo estoy usando bastante, pero me sigue pareciendo que hay un hueco muy grande entre el 1x y el 3x. Y los 12 megapíxeles del iPhone no dan para hacer un recorte del sensor principal para simular ese 2x que me falta. Igual esto alimenta los rumores de que el año que viene subimos a 48 mpx, pero tampoco quiero especular demasiado, que luego todo son decepciones.

Estilos Fotográficos

Uno de los puntos fuertes y a la vez débiles del iPhone ha sido siempre su procesado. Desde la introducción de Smart HDR con el iPhone XS parece haber una batalla dentro de Apple sobre hacia dónde llevar el estilo de las fotos que hace la cámara.

En su primera versión Smart HDR levantaba tanto las sombras que a veces las fotos quedaban planas. Desde entonces el procesado se ha relajado y en general los iPhone se caracterizan por fotos relativamente naturales y sin demasiado contraste.

Los estilos fotográficos te permiten regular el procesado de Smart HDR a tu gusto, hasta cierto punto. ¿Te gustan las fotos más contrastadas de un Google Pixel? Puedes emularlo. ¿Te gusta el look colorido de los Samsung? Sin problema.

Esto no son simples filtros, esto son cambios de los ajustes del procesado de las fotos que además se aplican de forma semántica, es decir, que distintos elementos reciben distintos ajustes (caras, cielos, plantas…). Por defecto hay 4 presets que se pueden retocar para llevarlos al punto exacto que quieras.

Aunque no he hecho pruebas exhaustivas he de decir que funcionan bien, pero también creo que el hecho de aplicarse tan selectivamente a distintos elementos hace que sea difícil hacer una valoración clara de cómo afectan, ya que la situación, el clima y lo que vayas a fotografiar pueden influir bastante en el resultado final.

Mi recomendación es que los probéis y, elijáis el que elijáis, lo uséis de forma sutil, ya que no es algo que se pueda cambiar a posteriori. Usados con cuidado os asegurais de que la foto se podrá editar para contrarrestar el efecto a mano si no os gusta como queda.

Video y Modo Cine

Hace ya años que el iPhone se ha impuesto como el smartphone para video. Podemos discutir durante horas sobre si otros terminales hacen mejores fotos, pero en cuanto a vídeos, Apple sigue siendo la reina.

La corona se mantiene un año más, con una calidad de video que sigue siendo sorprendente para un teléfono móvil y con pequeños arreglos como mayor consistencia en la fusión de HDR, evitando flickeos en los cielos y la mejora en la estabilización gracias al sensor principal estabilizado.

El nuevo telefoto 3x es maravilloso en video, y con objetos o personas a distancias cercanas genera un bokeh y un look bastante peliculero.

Pero para el look cinematográfico tenemos el nuevo «Modo cine». Esta función es, para mi, lo más interesante de todo el sistema de cámaras del iPhone 13 Pro, igual que lo fue el modo retrato para fotos con la salida del iPhone 7 Plus.

Lo que hace el modo cine es utilizar dos lentes simultáneas para generar un mapa de profundidad y con ello aplicar un efecto bokeh al video que estás grabando. Como el modo retrato de fotos, pero en vídeo.

Este modo tiene un par de limitaciones. La primera es que solo funciona a 1080p 30fps. No “hasta 30 fps”, 30 fps clavados. Poco cinematográfico a mi parecer, y espero que permitan 24 fps en el futuro. Tampoco funciona con la lente gran angular, solo con la principal y el tele.

Antes de juzgar los resultados de este modo creo que hay que tener en cuenta lo que está haciendo el iPhone a nivel técnico para que esto funcione. En el momento en el que seleccionas este modo, el procesador A15 está recibiendo 2 streams de video a 1080p en 10bit, comparando ambos, detectando objetos, personas y animales y luego generando un mapa de profundidad de 320×180 (!!!) y aplicando un desenfoque progresivo al resultado. Todo esto 30 veces por segundo.

No sirve el mismo mapa de profundidad que usarías para una foto en modo retrato porque con ese nivel de detalle los bordes vibrarían y tendrían artefactos. Se tiene que aplicar un suavizado temporal al mapa para que quede natural en movimiento. Sospecho que la baja resolución del mapa de profundidad también ayuda a suavizar el efecto.

Una vez entiendes esto, los resultados son bastante milagrosos; sobre todo teniendo en cuenta que es la primera versión de esta función. Es muy fácil posicionarse de forma cínica con algo así y resaltar todos los problemas que tiene el efecto, que los tiene, pero creo que es mejor entender el por qué de las limitaciones y pensar en las posibilidades que tendrá a medida que lo vayan mejorando.

En general la ilusión funciona. Cuanto más cerca esté lo que estamos grabando, mejor se verá. Personas que estén a varios metros de nosotros tendrán problemas con el recorte. Los pelos sueltos, hilos, hojas, ramitas y demás objetos finos se pierden fácilmente, pero es comprensible, el mapa de profundidad tiene muy poca resolución actualmente.

Creo que muchas veces queda mejor cuando el objeto desenfocado es el que está en primer plano, y el fondo es lo que queda enfocado.

Ante todo, y al igual que con una cámara “grande”, la profundidad de campo ha de usarse para guiar la mirada del espectador hacia lo que el director quiere que se mire, por lo que usado de forma inteligente los defectos pueden camuflarse.

Además, a diferencia de una foto en la que tienes todo el tiempo que quieras para analizar si el modo retrato muestra problemas, en video los planos duran mucho menos tiempo, por lo que el espectador no siempre llega a darse cuenta de que el efecto es imperfecto.

En mis pruebas he grabado planos que hasta a mí me parecían ser de una cámara y también he grabado planos que eran completamente insalvables. Es todo una cuestión de entender los puntos fuertes y débiles de la tecnología.

No contentos sólo con ofrecer esta posibilidad al grabar, el iPhone te permite cambiar los puntos de enfoque a posteriori. Solamente hay que ir a editar el video y en la línea de tiempo puedes marcar el punto de enfoque que quieras en el segundo que quieras, pudiendo “dirigir” el enfoque de la cámara como si fueras tu propio focus puller.

Además de los problemas del algoritmo de profundidad, otro problema que me he encontrado es que a veces el enfoque virtual y el enfoque real entran en conflicto.

Si estás grabando un objeto que está cerca de la cámara, la propia lente generará un desenfoque real detrás del objeto; pero si luego editas el enfoque virtual e intentas enfocar el fondo, saldrá desenfocado porque la lente real estaba enfocada en el primer plano.

En el video de ejemplo que he puesto hay un par de planos donde me ha ocurrido esto. En estos casos también se puede desactivar el modo cine completamente del clip grabado, y dejarlo con el enfoque natural.

No creo que el modo cine sea la revolución que Apple intenta vender en su marketing, pero sí que estoy totalmente convencido de que vamos a ver a mucha gente hacer genialidades y que durante los próximos años lo veremos mejorar y reducir, poco a poco, el margen de calidad entre el iPhone y una cámara “de verdad”.

Soy un fan enorme de cualquier herramienta o función que permita a la gente expresar su creatividad, aunque tenga limitaciones. El modo cine del iPhone 13 Pro entra firmemente en esa categoría. Muy a favor.

ProRes

Mientras escribo estas palabras Filmic Pro ha lanzado un actualización que permite grabar video en ProRes en el iPhone 13 Pro. ProRes, para quien no lo sepa, es el codec profesional de video de Apple, con un nivel de compresión mucho menor que el H264 o H265 que utilizan los smartphones normalmente y mayor precision de color.

También significa que los archivos grabados en ProRes pesan una barbaridad, y Apple no lo ha puesto fácil para sacarlos a buena velocidad del dispositivo.

Solamente he grabado un par de clips y visto algunas muestras en YouTube, pero es espectacular. No solo es que el video salga sin los típicos artefactos de compresión, es que diría que tiene menos procesado, como la nitidez artificial. El video parece estar compuesto de fotos a calidad completa, pero en movimiento.

Por el momento está limitado a 30 fps en 4K (solo en iPhones 13 Pro de 256 GB o más) y hasta 60 fps en 1080. Los codecs disponibles son ProRes Proxy, LT, estándar y HQ. Todos ellos a 10 bit 4:2:2. Etalonar o hacer chromas con el iPhone van a ser muchísimo más fácil a partir de ahora.

¿La mejor cámara en un móvil?

Sería muy fácil acabar este post diciendo que el iPhone tiene la mejor cámara en un móvil, pero la realidad es más compleja.

Creo que el iPhone tiene la cámara en la que puedes confiar en prácticamente cualquier situación, pese a que haya terminales del mundo Android que por pura fuerza bruta de sensor puedan hacer mejores fotos en muchas situaciones.

Las distintas lentes, combinadas con un procesado adecuado, que además ahora se puede ajustar y que da los mismos resultados de color y exposición en todas las focales es algo que no se encuentra en la mayoría de smartphones del mercado.

La calidad de video, sin siquiera incluir cosas como el modo cine, está varios escalones por encima del resto, y el modo cine es un poco la guinda para quién tenga interés en algo así. Tampoco podemos olvidar el ecosistema de aplicaciones para iOS que aportan nuevas posibilidades creativas que en Android no existen.

Hay bastantes cosas que mejorar. Y si es cierto que las cámaras de los iPhone se planifican 3 años antes de su salida al mercado puede que estemos un buen tiempo esperando algunas de ellas.

Mi wishlist personal incluye cosas como un mejor procesado con más detalle en las texturas, mejoras en el modo retrato, mejor gestión de altas luces e incluso alguna forma de recuperar ese 2x que hemos perdido.

Mientras tanto, el iPhone 13 Pro me ha demostrado ser una buena mejora tras la ligera decepción del 12 Pro y creo que si vienes de un modelo anterior al 11 el cambio es bastante radical. Quien venga de un 11 Pro o 12 Pro podrá hacer mejores fotos en ciertas situaciones, pero las típicas fotos en luz diurna son casi idénticas.

Al final, no hay que olvidar que el iPhone es una herramienta y que lo más importante para hacer buenas fotos es la luz y la habilidad del fotógrafo.

Y este José Jacas quién es ?

Está en todas partes. Bravo por este análisis.

Le conocerán en su casa a la hora de comer

Como queda claro, una persona que sabe mucho de imagen y de los iPhone. Y ahora, un nuevo colaborador de Photolari que estamos encantados de tener por aquí. Saludos

La pregunta es… ¿qué más da quién sea? Valora su trabajo, no si es alguien o deja de serlo.

+1000

Y tu? bueno con esta pregunta despejas la duda ya sabemos lo que no eres…..

¡Bien dicho, Iker!

Me ha encantado el análisis de Jose.

Muy buen análisis! Encantado de volver a ver al señor Jacas haciendo Reviews!

La cámara engorda o no le sienta muy bien a la chica. No me ha gustado mucho la review, bajó mi experiencia con el 13 pro la luminosidad es lo más destacable, pero el balance de blancos en el vídeo se va de madre y creo que los estilos no aportan nada…

Me ha resultado un análisis muy entretenido y ameno de leer, enhorabuena.

Si me gustaría hacer hincapié en que Jose nos explica cómo bajo su punto de vista desde el 11 al 12 apenas hubo mejoras, pero las opiniones el pasado año fueron todo lo contrario. Es curiosa esto que siempre sucede jeje, pero sobre todo con la manzanita.

Aplaudo la estabilidad de la fotografía de Apple y es bueno verles de nuevo en la lucha por la mejor cámara que durante un tiempo dejaron de lado, pues anima el mercado y a la competencia.

Este año que se supone habrá una gran revolución en los Google Pixel, a ver si también están a la altura, porque es el otro teléfono que te da una cámara estable y consistente.

Me ha encantado el análisis

Excelente review. Gracias

Buenísimo review !